ロボット向けAI技術を開発するPhysical Intelligenceは、ロボットの動作における遅延問題を解決する新技術「リアルタイムアクションチャンキング(RTC)」を発表した。同技術により、AIモデルの処理待ち時間による動作の中断や不連続性を解消し、より自然で安全なロボット制御が可能になる。

近年、視覚・言語・動作を統合したVLA(Vision-Language-Action)モデルが注目を集めているが、数十億のパラメータを持つこれらの大規模モデルは処理に時間がかかり、エッジデバイスでの実行時には通信遅延も加わって、実用化の障壁となっていた。従来の手法では、AIがコーヒーを手渡そうとしても、処理の遅れによってこぼしてしまうような事態が発生していた。

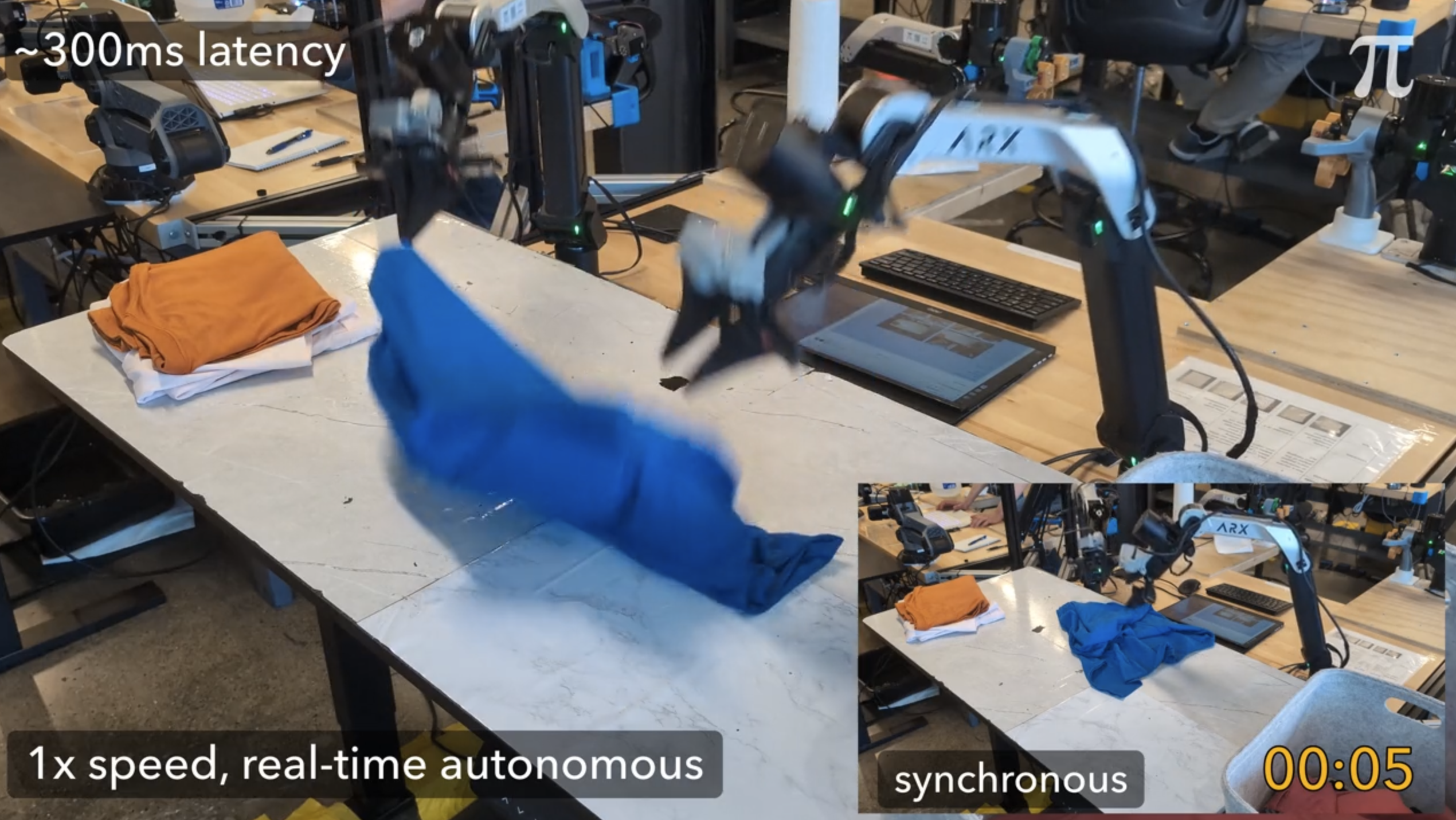

同社のπ0やπ0.5などのモデルでは、50個のアクション(約1秒分)をまとめて処理する「アクションチャンキング」を採用していたが、チャンク切り替え時に動作の不連続性が生じ、危険な加速や制御不能な動きを引き起こす問題があった。これまでは各チャンクの実行後に一時停止して次の処理を待つ同期方式を採用していたため、動作が不自然になり、処理速度も低下していた。

新開発のRTCは、この問題を画像インペインティングの手法を応用することで解決した。新しいチャンクの生成中も前のチャンクの実行を継続し、両者の重複部分を滑らかに接続する。拡散モデルやフローモデルベースのVLAに対して、トレーニング時の変更なしに適用できる点が特徴だ。

実験では、マッチで火をつける作業やイーサネットケーブルの接続といった高精度が要求されるタスクでテストを実施。300ミリ秒以上の遅延環境下でも、これらの精密作業を成功させることに成功した。人工的に100ミリ秒や200ミリ秒の遅延を追加した環境でも、パフォーマンスの低下はほとんど見られなかった。

この技術により、製造業の組立ラインでの精密作業や、家庭用サービスロボットの実用化が大きく前進すると期待される。特に、クラウド上の大規模AIモデルと連携するロボットシステムにおいて、ネットワーク遅延の影響を最小化できることから、より高度な知能を持つロボットの実現が現実的になってきた。今後は複数の抽象度レベルでの推論や、状況に応じて処理時間を調整する機能の開発が進められる見込みだ。